Parce que le syndicalisme est notre outil collectif de transformation sociale, il ne peut laisser personne à la porte de nos locaux, de nos réunions ou de nos luttes.

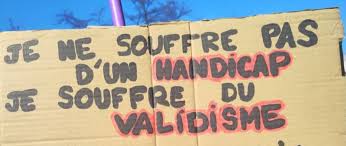

Fidèle à ses valeurs d’émancipation, l’Union syndicale Solidaires s’engage à déconstruire les barrières validistes qui excluent encore trop souvent les travailleuses et travailleurs en situation de handicap.

Ce livret de fiches pratiques n’est pas un simple guide technique ; c’est un outil politique. Il a pour but d’aider chaque militant et chaque militante à transformer nos pratiques quotidiennes. Qu’il s’agisse de rédiger un tract en FALC, d’organiser une manifestation accessible ou de défendre un aménagement de poste, chaque action concrète renforce notre solidarité.

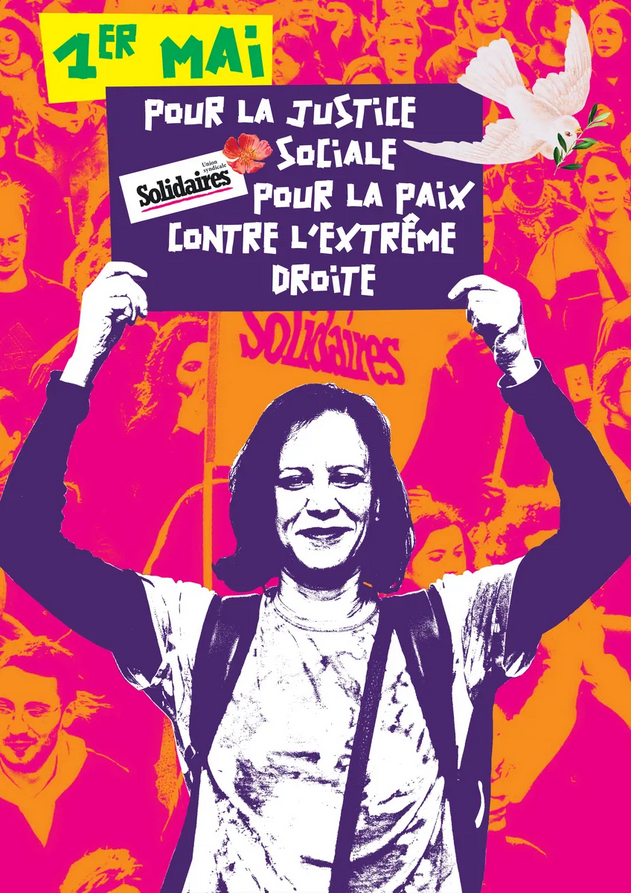

Faisons de nos structures des espaces réellement inclusifs où chaque camarade, quelles que soient ses capacités, peut prendre sa place, militer et porter nos revendications pour une société plus juste.

Fiches inclusivité Lire plus de publications sur Calaméo

- La question de la société inclusive : quelle société porte-t-on dans Solidaires ?. 3

Vers un syndicalisme inclusif 4

La commission de lutte contre les discriminations liées au handicap : 5

- Communiquer et mobiliser 7

FICHE 1 : Communiqués et Tracts. 8

FICHE 2 : Manifestations et Rassemblements. 9

FICHE 3 : Accessibilité Numérique. 10

FICHE 4 : Le FALC (Facile à Lire et à Comprendre) 11

FICHE 5 : Le Plan Visuel (Facilitation graphique) 14

- La vie syndicale interne. 15

FICHE 6 : Réunions et Assemblées Générales (AG) 16

FICHE 7 : Formations Syndicales (Pédagogie) 17

FICHE 8 : Table ronde et Événements Publics. 18

FICHE 9 : Le ou La Référent·e Handicap de la structure. 19

FICHE 10 : Modèle de Questionnaire d’accessibilité. 20

- Défense des travailleurs et des travailleuses (juridique & institutionnel) 21

FICHE 11 : L’Aménagement Raisonnable. 22

FICHE 12 : Le ou La Référent·e Handicap de l’entreprise. 24

FICHE 13 : Élections Professionnelles et Représentativité. 25

FICHE 14 : Défense Juridique et Discriminations. 26

FICHE 15 : Télétravail et Inclusion. 28

- Agir dans les Instances. 30

FICHE 16 : Les principales institutions. 31

FICHE 17 : Modèle de lettre pour l’Union Départementale (UD) 32

FICHE 18 : Agir en FSSSCT (Secteur Public / Hôpital) 33

FICHE 19 (Développée) : Agir en CSE / CSSCT (Secteur Privé) 34

- Outils et culture militante. 35

FICHE 20 : Lexique et Culture de l’Allié·e. 36

La check-list finale. 37

- RESSOURCES : Liens utiles pour l’accessibilité. 38

- Pour la défense juridique et les droits. 38

- Pour l’accessibilité numérique et documentaire. 38

- Pour l’accessibilité des lieux et le matériel 38

- Pour la communication (LSF et Interprétariat) 38

- Culture et Lutte (Pour déconstruire le validisme) 39

- Glossaire. 40

La question de la société inclusive : quelle société porte-t-on dans Solidaires ?

Dans une société capitaliste archi-normée, la “pleine santé” et les capacités physiques ou psychiques permanentes sont érigées en normes absolues. Ce leurre théorique sert avant tout à évaluer notre capacité à produire : quiconque s’éloigne de cette norme est mis au ban de la société et du monde du travail.

Pourtant, personne n’est en “pleine capacité” tout au long de sa vie. L’idée d’une indépendance totale est un mythe : nous sommes toutes et tous interdépendant·es.

Solidaires refuse de considérer le handicap comme une “défaillance” individuelle qu’il faudrait traiter avec une vision de “bonne samaritaine”. Pour nous, il s’agit de renverser les normes. Nous combattons l’organisation productiviste du travail qui exclut celles et ceux qui ne rentrent pas dans ses cases.

Parce que ce sont simplement différentes manières d’exister, Solidaires milite pour un aménagement du travail et de la cité garantissant les mêmes droits pour toustes. Nous ne voulons pas seulement “inclure” à la marge, nous voulons transformer la société pour qu’elle s’adapte à la diversité des corps et des esprits, et non l’inverse.

Nous possédons pour cela un outil : la charte de l’ONU de 2006 que la France a ratifié en 2010. En effet, celle-ci met l’accent sur une notion sociale et environnementale du handicap, à l’inverse d’une vision médicalisée qui est malheureusement celle encore privilégiée en France. Pour faire simple, c’est à la société de s’adapter et non l’inverse.

Dans nos unions syndicales départementales, nous préconisons la mise en place d’un-e référent-e handicap afin de soutenir la prise en compte de cette notion socio-environnementale du handicap.

Pour la vie autonome et l’inclusion dans la société des personnes en situation de handicap, Solidaires réclame que notre pays (Résolution 2 du Congrès de Labège/Toulouse 2024) :

- Respecte la Convention relative aux droits des personnes handicapées qu’elle a ratifiée en 2010.

- Mette en place les moyens humains, matériels et financiers pour rendre possible et durable l’autonomie des personnes handicapées dans la société.

- S’engage à tout mettre en œuvre pour permettre la vie autonome, la citoyenneté pleine et entière des personnes en situation de handicap.

Vers un syndicalisme inclusif

Résolution du congrès de Labège/Toulouse 2024 :

Pour déconstruire les préjugés et certitudes toutes faites, relatives aux salarié·es en situation de handicap, les structures de l’Union syndicale Solidaires s’engagent à :

● Multiplier les formations sur le sujet.

● Accompagner les travailleurs·euses en situation de handicap et à défendre leurs droits.

● Œuvrer à la mise en place d’un·e référent·e formé·e handicap dans l’ensemble des structures de notre Union. Ces missions devraient s’appuyer sur le vécu des personnes concernées.

● Faire un état des lieux et s’améliorer pour permettre l’accessibilité à toustes de nos locaux, mais aussi des lieux et matériels de formation.

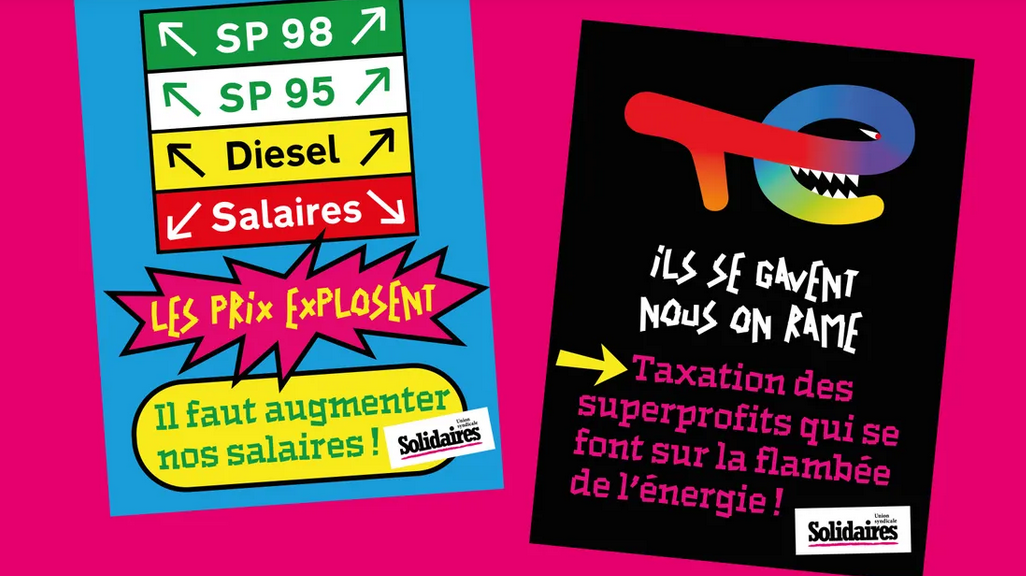

● Penser nos activités militantes y compris dans nos instances pour les rendre inclusives au plus grand nombre (ex support de communication, parcours de manifestations, recours aux interprètes en langue des signes).

Plusieurs points doivent être réfléchis, évalués et budgetés afin que les personnes en situation de handicap ne soient pas exclues du syndicat. Certains points nécessiteront obligatoirement l’intervention de professionnel·les. Cela doit bien évidemment se faire selon le principe « Rien sur nous sans nous ». Solidaires travaillera à un cahier d’inclusivité à destination des structures.

● Syndiquer les travailleurs et travailleuses en situation de handicap sans discrimination.

● Travailler à l’ouverture de sections dédiées aux travailleurs et travailleuses des ESAT qui doivent pouvoir s’organiser collectivement (et ont le droit de se syndiquer depuis le 1er janvier 2024).

● Tisser des liens et participer aux actions des associations de personnes en situation de handicap qui partagent nos valeurs.

Solidaires doit donc penser ses activités militantes pour les rendre inclusives au plus grand nombre.

La commission de lutte contre les discriminations liées au handicap :

La commission Handicap de Solidaires, mise en place en 2021, poursuit cet objectif. Elle doit être renforcée. Les formations sur cette problématique, dans le cadre du CEFI, doivent s’amplifier ; elles sont un pan important de notre syndicalisme.

Pour avancer sur ces questions-là, cela implique aussi de repenser nos réunions, AG, manifestations, actions, etc.

On doit réfléchir à l’accessibilité des locaux syndicaux et améliorer l’existant quand cela est possible ou en cherchant des locaux accessibles si l’on déménage.

On doit aussi réfléchir à la tenue de nos réunions et formations : y’a-t-il un espace de repos pour les personnes qui en auraient besoin ? des masques sont-ils à dispositions ? un détecteur de CO2 ? Le renouvellement de l’air ? Une boucle magnétique ? y-a-t-il une traduction LSF ? Et si non, faut-il en prévoir une ? Nous pouvons joindre automatiquement un questionnaire à tous les événements demandant une inscription (réunion, conseil, congrès, formation…).

Ces lieux de rencontres devraient toujours avoir un accès PMR et un espace de repos.

Et cela implique aussi de à repenser nos manifestations pour les rendre plus inclusives : longueur du parcours ? y’a-t-il des toilettes accessibles sur le trajet ? si non, est-il possible de trouver des bars ou restaurants « alliés » qui voudraient bien proposer leur toilette ? Y-a-t-il un « espace plus calme dans la manif » ? Si le parcours est long, quelles sont les alternatives (par exemple pour le 8 mars 2024 à Toulouse, il était indiqué qu’il était possible de rejoindre la manif directement à telle station de métro), etc. Les discours seront-il traduits en LSF ? On se doit d’anticiper et de communiquer en amont sur ce qui est en place ou pas.

C’est de toutes ces réflexions que découlent les fiches ci-dessous.

Communiquer et mobiliser

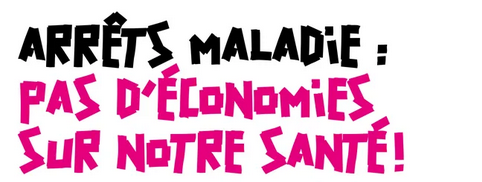

FICHE 1 : Communiqués et Tracts

Objectif : Rendre l’information accessible à tous et toutes, y compris aux personnes avec des troubles visuels, cognitifs ou Dys.

Pour chaque tract, proposez systématiquement une version alternative en format .docx ou .odt. Ce fichier doit être « nu » : pas de colonnes, pas d’images de fond, uniquement du texte propre. C’est ce qu’on appelle un document « text-only ». C’est la seule garantie que le logiciel de synthèse vocale d’un·e camarade malvoyant·e lira les infos dans le bon ordre.

- Rédaction : Utiliser des phrases courtes (Sujet-Verbe-Complément).

- Vocabulaire : On bannit le “jargon syndical” pur. Si on utilise un acronyme (ex: l’ordonnance de 2017), on explique ce que c’est en une phrase.

- Structure : Un seul sujet par paragraphe. Utilisez des intertitres en gras pour que l’on puisse comprendre le message juste en survolant le texte.

- Police : Utiliser des polices sans empattement (ex: Arial, Helvetica, Verdana) en taille 12 minimum.

- Mise en page : Ne pas justifier le texte (l’aligner à gauche) pour éviter les espaces irréguliers entre les mots qui gênent la lecture (le texte justifié crée des espaces inégaux entre les mots qui bloquent la lecture des personnes dyslexiques).

- Alternative : Pour les documents importants, proposer une version en FALC (Facile à Lire et à Comprendre).

- Numérique : Pour les PDF envoyés par mail, s’assurer qu’ils sont “lisibles” par les logiciels de synthèse vocale (éviter les scans de mauvaise qualité qui sont des images).

- Féminisation des textes : Solidaires porte l’égalité femmes-hommes. Pour que cette inclusion ne devienne pas une exclusion pour nos camarades dyslexiques ou malvoyant·es, privilégiez la double flexion « les militants et les militantes » ou les mots neutres ou épicènes « le collectif » « les élèves ». Si vous utilisez le point médian, assurez-vous qu’il s’agit bien d’un point milieu · et non d’un point final . (qui coupe la phrase pour les logiciels vocaux) ou d’un tiret qui n’est pas lu de la même façon.

FICHE 2 : Manifestations et Rassemblements

Objectif : que toutes les personnes qui le souhaitent puissent participer.

- Parcours : Indiquer à l’avance les stations de métro/bus accessibles (ascenseurs) pour rejoindre ou quitter le cortège.

- Zones de repli : Identifier sur le trajet des “espaces calmes” ou des points de rendez-vous intermédiaires pour celles et ceux qui ne peuvent pas suivre tout le parcours.

- Logistique : Repérer et lister les toilettes accessibles aux PMR sur le trajet (cafés alliés, sanitaires publics, cinémas).

- Visibilité : Prévoir une zone près du camion sono/discours pour les personnes en fauteuil afin qu’elles ne soient pas noyées dans la foule.

- Traduction : Si possible, prévoir une interprétation des prises de parole en LSF (Langue des Signes Française) sur le camion de tête.

Pour exemple à Toulouse, lors des mobilisations du 8 mars, des camarades font le trajet de la manifestation en amont, notent les stations de métro sur le trajet (et proposent par exemple un trajet alternatif si celui-ci est long, en disant où rejoindre le cortège), les toilettes accessibles, voire négocient avec des bars sur le trajet pour que les personnes puissent y accéder sans consommer, font appel à des traductrices LSF pour les prises de parole, ou encore organisent des cortèges « calmes » éloignés des sonos.

Autre exemple : lors de grands rassemblements contre les méga-bassines, les sites ont été construits de manière inclusive. Plan, affichages clairs, indications des tables rondes traduites en LSF, précision sur l’accessibilité PMR, mise en place d’espaces « calmes », etc.

FICHE 3 : Accessibilité Numérique

L’objectif : Ne pas créer de barrières virtuelles.

- Texte alternatif (Alt-Text) : Sur Facebook, X (Twitter) ou Instagram, remplissez toujours la case “texte alternatif” pour décrire vos images. Les personnes malvoyantes utilisent des lecteurs d’écran qui lisent cette description.

- Les contrastes : Évitez d’écrire en jaune sur blanc ou en gris clair sur blanc. Utilisez des contrastes forts (ex: Noir sur Jaune, ou Blanc sur Bleu foncé).

- Hashtags : Utilisez le PascalCase (une majuscule à chaque mot). Exemple : #SyndicalismeInclusif et non #syndicalismeinclusif. Cela permet aux synthèses vocales de prononcer les mots séparément.

- Vidéos : Ne postez aucune vidéo sans sous-titres. 80% des gens regardent les vidéos sans le son, et c’est indispensable pour les personnes sourdes et malentendantes. Sur plusieurs réseaux sociaux, il est aujourd’hui possible de créer le sous-titrage assez rapidement et de nombreux outils gratuits permettent de le faire automatiquement (CapCut, YouTube Studio, etc.). Une relecture est indispensable car les sous-titrages automatiques sont parfois faux ou ambigus (pour exemple à Toulouse : résistance Qatar au lieu de cathare …)

- Documents PDF : Évitez les “scans” de tracts papier qui sont vus comme des images par les logiciels. Préférez l’export direct depuis Word ou Canva en mode “PDF accessible”.

Quelques sources :

FICHE 4 : Le FALC (Facile à Lire et à Comprendre)

L’objectif : Rendre l’information syndicale accessible à celles et ceux qui ont des difficultés de lecture ou de compréhension.

Quand utiliser le FALC ?

- Pour les consignes de sécurité dans les locaux.

- Pour un tract de base présentant les droits aux congés ou à la santé.

- Pour le compte-rendu simplifié d’une instance (CSE, AG).

- Pour les professions de foi et bulletins de vote lors des élections professionnelles.

1. Les règles d’écriture (Le fond)

- Mots simples : Utiliser des mots de la vie quotidienne. Éviter les sigles (ou les expliquer systématiquement : “La CPAM, c’est la caisse de l’Assurance Maladie”).

- Phrases courtes : Une seule idée par phrase. Sujet + Verbe + Complément.

- Ton direct : Utiliser la forme active et s’adresser directement au lecteur (“Vous pouvez…” plutôt que “Il est possible de…”).

- Éviter l’abstrait : Ne pas utiliser de métaphores ou de second degré qui peuvent être mal interprétés.

2. La mise en page (La forme)

- Typographie : Utiliser une police bâton (Arial, Tahoma) de taille 14 minimum.

- Structure : Aligner le texte à gauche (ne pas justifier). Éviter d’écrire tout en majuscules ou en italique.

- Sauts de ligne : Aller à la ligne après chaque point. Laisser beaucoup d’espaces blancs pour ne pas “étouffer” le lecteur ou la lectrice.

- Bullet points : Utiliser des listes à puces pour énumérer des idées.

3. L’usage de l’image

Le FALC est indissociable du visuel. Chaque paragraphe important doit être illustré par un pictogramme ou une image simple qui explique le sens du texte.

- Exemple : À côté d’un texte sur le droit de grève, mettre un dessin de manifestant·es.

Banques d’images gratuites :

Il existe des banques d’images gratuites et spécialisées. Le plus important est de garder une unité graphique (ne pas mélanger des photos et des dessins différents dans un même document).

- Sclera.be : C’est la référence. Des pictogrammes en noir et blanc, très contrastés et très simples. Ils sont parfaits pour les livrets syndicaux. https://sclera.be/fr/vzw/home

- ARASAAC : Une immense base de données (couleurs ou noir et blanc). Tu peux chercher par mots-clés (travail, réunion, syndicat). https://beta.arasaac.org/

- Mulberry Symbols : Des pictogrammes très clairs, souvent utilisés dans le milieu du soin et de l’accessibilité. https://www.opensymbols.org/

- Santé BD : Iels proposent des illustrations très bien faites sur la santé et les droits, que l’on peut parfois réutiliser pour des sujets liés aux conditions de travail. https://santebd.org/

Conseil : Évitez les “emojis” de téléphone qui peuvent être trop petits ou ambigus. Privilégiez des dessins qui représentent une action concrète.

4. Le principe d’or : La relecture

Pour qu’un document soit officiellement estampillé “FALC” (avec le logo européen bleu), il doit être relu et validé par une personne en situation de handicap mental.

- Si vous rédigez un tract de section en FALC, demandez à des camarades concerné·es ou à des travailleurs·euses d’ESAT ce qu’ils et elles en pensent. S’ils et elles ne comprennent pas, c’est que le texte doit être encore simplifié.

5. Exemple de Profession de Foi en FALC

Une profession de foi classique est souvent trop dense. En FALC, on va droit au but avec des “blocs” d’information.

Structure type :

- Titre : Voter pour [Nom du Syndicat] (avec le logo du syndicat).

- C’est quoi les élections ?

- Le [Date], on vote pour le CSE (Comité Social et Économique).

- À quoi sert le CSE ? Le CSE a 3 rôles importants :

- 1. Il parle avec le patron

- Le CSE pose des questions au patron.

- Le CSE dit au patron ce qui ne va pas dans l’entreprise.

- Le CSE défend vos droits.

- 2. Il protège votre santé

- Le CSE vérifie que le travail n’est pas dangereux.

- Il regarde si les machines sont sûres.

- Il s’inquiète si vous êtes trop fatigué ou stressé.

- 3. Il propose des activités (dans les grandes entreprises)

- Le CSE peut offrir des chèques cadeaux (pour Noël, par exemple).

- Il peut payer une partie de vos tickets de cinéma ou de sport.

- Il organise parfois des fêtes ou des voyages.

- C’est important pour choisir les personnes qui vont vous défendre.

- Pictogramme : une urne et un bulletin de vote.

- Pourquoi voter pour nous ?

- Nous voulons que votre travail ne soit pas dangereux pour votre santé.

- Nous voulons que tout le monde soit respecté au travail.

- Nous voulons augmenter votre salaire

- Pictogramme : des mains qui se serrent ou des pièces de monnaie.

- Nos idées pour le handicap

- L’entreprise doit adapter votre bureau si vous en avez besoin.

- L’entreprise doit vous laisser du temps pour vos soins.

- Pictogramme : une rampe d’accès ou une horloge.

- Comment voter ?

- Le vote est secret. Personne ne sait pour qui vous votez.

- Il faut mettre le bulletin dans l’enveloppe.

- Pictogramme : une personne derrière un rideau (isoloir).

Ajout si le vote est numérique :

Comment voter sur l’ordinateur ?

Le vote se fait sur internet. C’est facile et c’est secret.

- Le matériel :

- Tu peux voter avec un ordinateur, une tablette ou votre téléphone.

- Pictogramme : un ordinateur et un smartphone.

- Vos codes :

- Tu peux recevoir un message avec un identifiant (votre nom) et un code secret.

- Ne donne pas ton code secret à quelqu’un d’autre.

- Pictogramme : un cadenas ou une clé.

- Le vote :

- Va sur le site internet du vote.

- Tape ton identifiant et ton code.

- Clique sur le logo Solidaires.

- Clique sur le bouton “Valider”.

- Pictogramme : une souris d’ordinateur qui clique sur un bouton.

Si tu as des difficultés avec l’outil informatique, tu peux te faire aider par une personne de ton choix. Mais attention : c’est toi qui choisis pour qui tu votes. Ce n’est pas elle.

- C’est fini :

- Un message s’affiche pour dire “Merci, votre vote est enregistré”.

- C’est comme mettre une enveloppe dans une boîte, mais c’est numérique.

- Pictogramme : un pouce levé ou une enveloppe entrant dans un écran.

FICHE 5 : Le Plan Visuel (Facilitation graphique)

L’objectif : Une boussole temporelle pour nos formations et Assemblées Générales.

- Pourquoi ? Pour réduire l’anxiété liée à l’inconnu et aider à la concentration.

- Quoi afficher ? Sur un grand papier (type Paperboard) à l’entrée de la salle :

- Le dessin d’une horloge pour chaque étape.

- Des pictogrammes : une tasse (pause), un couvert (repas), une bulle (débat), un stylo (travail en groupe).

- L’usage : Barrez les étapes au fur et à mesure que la journée avance. Cela donne un sentiment d’accomplissement et de clarté.

Un exemple (il manque le cadrage horaire)

La vie syndicale interne

FICHE 6 : Réunions et Assemblées Générales (AG)

L’objectif : Garantir que la fatigue ou le handicap ne soient pas des obstacles à la participation démocratique.

- L’organisation du temps

- La règle des 90 minutes : Ne jamais dépasser 1h30 de réunion sans une pause réelle de 15 minutes. Le cerveau et le corps ont besoin de déconnecter pour rester efficaces.

- Le moment des décisions : Placer les points cruciaux à l’ordre du jour le matin ou en début de réunion. En fin de journée, la fatigue cognitive est maximale, ce qui exclut de fait les camarades ayant une faible réserve d’énergie, mais aussi celles qui effectuent le plus de tâches domestiques et de soins aux personnes.

- Respecter l’horaire de fin : Pour les personnes qui gèrent des soins, des transports adaptés ou une fatigabilité lourde, le respect de l’heure de fin est une condition de leur venue.

- Le confort et l’espace

- L’assise : Proposer différentes options dans la mesure du possible. Bannir les tabourets et les bancs sans dossier qui sont un calvaire pour le dos (par exemple la superbe salle Ambroise Croizat avec la verrière à la Bourse du Travail de Paris est à bannir en termes d’accessibilité, d’assises, d’acoustique)

- L’espace de repli : Identifier une salle ou un coin calme à proximité immédiate avec un fauteuil ou un tapis. Ce “Quiet Corner” permet à un·e camarade de s’isoler 10 minutes en cas de surcharge sensorielle ou de douleur, sans devoir rentrer chez soi.

- Qualité de l’air et accessibilité sensorielle

- Santé respiratoire : Maintenir le taux de CO2 sous 800 ppm (détecteur). Une mauvaise aération augmente la fatigue de tout le monde et met en danger les personnes fragiles.

- Le son : Utiliser un micro, même si “on pense qu’on parle fort”. Cela permet aux personnes avec des appareils auditifs de capter la voix sans l’écho de la salle.

- La lumière : Éviter les néons qui clignotent ou les lumières trop agressives (gênantes pour les personnes migraineuses ou autistes). Préférer une lumière indirecte si possible.

- Soutien à la prise de décision

- L’ordre du jour visuel : Afficher le déroulé au mur. Barrer les points traités pour que chacun·e puisse visualiser l’avancement.

- Documents à l’avance : Envoyer les textes soumis au vote 3 jours avant. Cela permet de prendre connaissance du sujet au calme et d’arriver en AG prêt·e à débattre, sans stress de lecture immédiate.

“La démocratie, c’est aussi savoir s’arrêter.” Si un débat s’envenime ou dure trop longtemps en fin de journée, proposez de reporter le vote au lendemain ou à une réunion ultérieure. Une décision prise dans l’épuisement collectif n’est jamais vraiment démocratique.

L’objectif : Transmettre le savoir sans épuiser les stagiaires.

- L’Anticipation

- Documents en amont : Envoyer les textes de référence quelques jours avant. Cela permet aux camarades dyslexiques ou ayant des troubles de l’attention de lire à leur rythme, sans la pression du groupe.

- Le “Qui fait quoi” : Préciser dès l’accueil qui sont les formateur·ices et comment va se dérouler la logistique (repas, sanitaires, salle de pause,etc). L’imprévu est source d’une grande fatigue cognitive pour les personnes neuroatypiques (autisme, TDAH).

2. Le Rythme

- La règle des pauses : faire 15 min de pause toutes les 90 min.

- Le “Temps mort” de midi : Prévoir une pause déjeuner d’au moins 1h30. Ce temps n’est pas “perdu” : il permet de recharger les batteries sociales.

- Fin de journée : Ne jamais déborder après 17h. La fin de journée est le moment où la “double tâche” (suivre la formation + compenser son handicap) devient épuisante et peut provoquer des malaises ou des crises de fatigue.

3. Les Supports

- Multi-sensorialité : Ne faites pas que parler. Utilisez des schémas, des vidéos sous-titrées, et des exercices pratiques, des travaux en petit groupe.

- Supports papier accessibles : Si vous distribuez des polycopiés, utilisez une police de taille 14 et laissez de larges marges pour la prise de notes.

- Limiter le texte à l’écran : Un diaporama ne doit pas être lu par la ou le formateur ou formatrice. Il doit illustrer le propos avec des mots-clés et des images.

4. La Pédagogie (S’adapter aux neuroatypies)

- Consignes claires : Pour les travaux de groupe, écrivez la consigne au tableau. Une consigne uniquement orale peut être oubliée ou mal interprétée.

- Droit au mouvement / à l’isolement : Autoriser explicitement les stagiaires à se lever, à s’étirer ou à sortir quelques minutes si besoin. Ce n’est pas de l’impolitesse, c’est de l’auto-régulation.

- L’Évaluation inclusive : À la fin, ne forcez pas tout le monde à rédiger une fiche. Proposez de faire un bilan oral, un dessin (carte mentale) ou un compte-rendu numérique.

“L’inclusion profite à tout le monde.” Un rythme plus calme et des consignes plus claires ne servent pas qu’aux camarades en situation de handicap : ils permettent à l’ensemble du groupe de mieux retenir les informations et de repartir de formation avec plus d’énergie pour militer !

FICHE 8 : Table ronde et Événements Publics

L’objectif : Garantir que nos débats soient accessibles à tous et toutes, tant à la tribune que dans le public.

1. Côté intervenant·es

- La Représentativité : “Rien sur nous sans nous”

- Légitimité : On n’invite pas que des “expert·es” ou des “professionnel·les” du handicap. On invite d’abord les personnes concernées et les collectifs de lutte (handi-féministes, anti-validistes).

- Diversité à la tribune : Veillez à ce que les intervenant·es en situation de handicap ne soient pas là uniquement pour témoigner de leur souffrance, mais pour porter une analyse politique et syndicale.

- Accueil des intervenant·es : Vérifiez que l’estrade (si elle existe) est accessible par une rampe et que la table est à la bonne hauteur pour un fauteuil.

- La Communication amont :

- L’annonce des moyens : Ne vous contentez pas de dire “accessible”. Précisez : “Salle au RDC, présence d’interprètes LSF de 14h à 16h, boucle magnétique disponible, parking PMR à 50m”.

- Besoins spécifiques : Proposez un mail de contact pour que les personnes puissent signaler un besoin particulier (ex: besoin d’un support en braille ou d’une place réservée près de l’interprète LSF). (Pour info, un logiciel libre de droits pour le braille : https://natbraille.org/ )

- L’Animation le jour J

- Description orale (Audiodescription) : Au début de chaque prise de parole, l’intervenant·e peut se décrire brièvement : “Je suis une femme, je porte un pull rouge, je suis assise à la droite du micro”. Si vous projetez une image ou un graphique, décrivez-le systématiquement : “L’image montre une manifestation de Solidaires avec de nombreux drapeaux”.

- Gestion du micro : Le micro n’est pas une option. Sans micro, les personnes malentendantes ou utilisant une boucle magnétique sont totalement exclues. Répétez toujours les questions du public dans le micro avant d’y répondre.

- Le débit de parole : Demandez aux intervenant·es de parler clairement et pas trop vite pour faciliter le travail des interprètes LSF ou des vélotypistes (Les vélotypistes utilisent un clavier particulier appelé vélotypie, qui leur permet de taper plusieurs touches simultanément pour générer des mots entiers ou des groupes de mots, cela permet un sous-titrage en direct).

- L’Accueil du public

- Placements réservés : Gardez des places au premier rang pour les personnes sourdes (pour bien voir l’interprète LSF ou lire sur les lèvres) et pour les personnes avec chien-guide.

- Espace de circulation : Ne saturez pas la salle de chaises. Laissez des couloirs larges pour que les personnes en fauteuil ou avec déambulateur puissent circuler sans gêner ni être gênées.

“L’accessibilité est un investissement politique.” Prévoir un budget pour la LSF ou la vélotypie est aussi important que de louer une salle. Si le budget est serré, mieux vaut faire un événement plus court ou plus petit, mais le plus accessible possible, plutôt qu’un grand rassemblement qui exclut une partie de notre classe sociale…

FICHE 9 : Le ou La Référent·e Handicap de la structure

L’objectif : avoir une/des personne(s) ressource pour que l’accessibilité devienne un réflexe collectif et non un casse-tête individuel.

Le congrès de Labège 2024, a dans ses recommandations suggérer d’avoir un·e référent·e handicap dans chaque Solidaires local. A ce jour ce rôle n’est pas défini.

Ci-dessous quelques réflexions/pistes sur ce qu’il ou elle pourrait faire/être.

L’idée n’est pas que ce soit un·e assistant·e social·e. Il/Elle s’appuierait sur le bureau du syndicat pour les décisions collectives et sur la commission handicap nationale pour des conseils. Son rôle principal serait d’impulser une dynamique, pas de porter seul·es la question de l’inclusivité dans le syndicat.

Il/Elle veillerait à ce que chaque réunion, AG ou formation de la structure s’organise dans l’esprit des fiches du présent guide. C’est la personne qui dit : “Attention, on a oublié de prévoir le micro” ou “Ce local n’est pas accessible, changeons de lieu”.

Son rôle serait aussi d’écouter, d’informer sur les droits (RQTH, AAH, PCH) et d’orienter vers les bons interlocuteurs et interlocutrices sans porter de jugement. Il/Elle pourrait accompagner les camarades dans leurs démarches (RQTH, dossiers MDPH) en lien avec les avocat·es/juristes de Solidaires. Il/Elle conseillerait les délégué·es syndicaux (DS) et les élu·es en CSE ou FSSSCT sur les dossiers de maintien dans l’emploi et d’aménagement de poste.

Enfin il ou elle pourrait aussi être un lien avec les collectifs de lutte anti-validistes.

FICHE 10 : Modèle de Questionnaire d’accessibilité

Questionnaire à destination des stagiaires

Si tu es en situation de handicap (avec ou sans reconnaissance officielle !) et que celui-ci t’impose des contraintes, tu peux avoir besoin d’aménagements dans le but de participer aux Conseils Syndicaux/réunions de sections syndicale et sections locales /AG/Universités d’été/manif.

Nous y apporterons toute l’attention possible.

Pour nous guider, tu peux répondre aux questions suivantes :

– As-tu une ou des allergies alimentaires ? Lesquelles ?

………………………………………………………………………………………………………………………………..

…………………………………………………………………………………………………………………………………

– Besoin d’aménagements

□ transport – □ accompagnement logistique

□ un accès adapté – □ accès à un lieu calme ressourçant

□ interprétation des textes – □ un·e interprète langue des signes

□ transcription des textes en braille □ accompagnement cognitif

– Peux-tu nous préciser quels sont tes besoins ?

…………………………………………………………………………………………………………………………………

………………………………………………………………………………………………………………………………….

………………………………………………………………………………………………………………………………….

………………………………………………………………………………………………………………………………….

- Tu es libre de vouloir, ou NE PAS VOULOIR nous transmettre quel est ton handicap, et

nous garderons confidentiel. Nous respecterons ton choix.

…………………………………………………………………………………………………………………………………

…………………………………………………………………………………………………………………………………

Défense des travailleurs et des travailleuses (juridique & institutionnel)

FICHE 11 : L’Aménagement Raisonnable

L’objectif : Imposer l’adaptation de l’environnement de travail à l’humain, et non l’inverse. Ce n’est pas une “faveur” de l’employeur, c’est un droit fondamental.

1. Le Cadre Légal :

- La Loi du 11 février 2005 : Elle pose l’obligation pour l’employeur de prendre des “mesures appropriées” pour permettre aux personnes handicapées d’accéder à un emploi, de le conserver et d’y progresser.

- Le Code du Travail (Art. L5213-6) : L’employeur doit procéder aux aménagements nécessaires, sauf s’il démontre que les charges sont “disproportionnées” (ce qui est quasi impossible à prouver vu les aides financières existantes).

- La Convention de l’ONU (CIDPH) : Ratifiée par la France, elle définit le refus d’aménagement raisonnable comme une discrimination fondée sur le handicap.

2. Le risque juridique pour l’employeur

Le refus d’aménager un poste n’est pas qu’un manque de bienveillance, c’est une faute grave.

- Sanction pénale : La discrimination est punie par le Code Pénal (Art. 225-1 et 225-2) jusqu’à 3 ans d’emprisonnement et 45 000 € d’amende.

- Sanction civile : Devant les Prud’hommes ou le Tribunal Administratif, le refus peut entraîner la nullité d’un licenciement pour inaptitude et le versement de dommages et intérêts importants.

- Le ou la délégué·e au Défenseur des Droits : peut être saisi·e par le/la salarié·e ou le syndicat. Il ou elle peut rendre des avis qui sont assez suivis par les tribunaux. La Défenseure des Droits rappelle régulièrement que l’employeur doit être proactif, c’est-à-dire qu’il ne doit pas attendre que le ou la salarié·e propose une solution, il doit la chercher.

3. Le rôle du syndicat

- Anticiper l’inaptitude : Trop souvent, l’employeur attend la visite de reprise pour dire “on ne peut rien faire”. Le syndicat doit intervenir dès les premiers signes de difficulté. Concrètement, le syndicat peut intervenir en contactant le ou la salarié·e pendant l’arrêt pour l’orienter vers la visite de pré-reprise, en exigeant de l’employeur l’organisation du rendez-vous de liaison (C. trav. art. L 1226-1-3 et D 1226-8), et en demandant des études de poste en CSSCT pour adapter l’environnement de travail avant même le retour physique du ou de la salarié·e.

- Casser l’argument financier : L’employeur prétend que c’est trop cher ? Rappelez-lui que l’Agefiph (privé) ou le FIPHFP (public) financent jusqu’à 100% des aménagements (prothèses, logiciels, travaux, formation).

- Exiger la concertation : L’aménagement doit être discuté avec le ou la salarié·e, la ou le médecin du travail et les élu·es du personnel (CSE/FSSSCT).

4. Quelques exemples concrets à revendiquer

- Matériel : Bureau réglable en hauteur, sièges ergonomiques, double écran, logiciels de dictée vocale, plages braille, autorisation explicite d’enregistrer des réunions ou échanges avec hiérarchie pour un usage individuel et temporaire professionnel.

- Organisation : Télétravail (même hors accord d’entreprise), aménagement des horaires pour les soins, suppression de certaines tâches pénibles, temps de repos supplémentaire.

- Espace : Élargissement des portes, signalétique contrastée, boucles magnétiques, suppression des obstacles au sol.

FICHE 12 : Le ou La Référent·e Handicap de l’entreprise

1. Le Cadre Légal :

- Loi n° 2018-771 du 5 septembre 2018 : Cette loi rend obligatoire la désignation d’un·e référent·e handicap dans toutes les entreprises employant au moins 250 salarié·es (Art. L5213-6-1 du Code du travail).

- Dans la Fonction Publique : L’obligation est similaire. Le ou la référent·e est l’interlocuteur ou interlocutrice privilégié·e pour la mise en œuvre des conventions avec le FIPHFP.

- Droit à l’information : Les élu·es du personnel (CSE / FSSSCT) doivent être informé·es de l’identité de ce ou cette référent·e. Son nom doit être affiché dans les locaux ou sur l’intranet.

2. Ses Missions Officielles

Selon la loi, ses missions sont d’orienter, d’informer et d’accompagner les personnes en situation de handicap. Concrètement, le syndicat peut l’interpeller pour :

- Le montage des dossiers d’aide : C’est lui/elle qui doit faire les démarches auprès de l’Agefiph ou du FIPHFP pour financer les aménagements de poste.

- La transition professionnelle : Il/elle doit faciliter le maintien en emploi lors d’une aggravation du handicap ou d’un retour après un long arrêt.

- La sensibilisation : Il/elle doit organiser des actions pour lutter contre les préjugés dans les services/ateliers.

3. Notre vigilance en tant que syndicaliste :

- Lien de subordination : Le ou la référent·e employeur est souvent un·e membre des RH ou de la Direction. Sa priorité reste la gestion de l’entreprise. Il ou elle ne remplace jamais le ou la délégué·e syndical·e ou les conseiller·es du salarié.

- Respect du secret médical : Attention ! Le ou la référent·e handicap n’est pas médecin. Il/elle n’a pas à connaître le diagnostic médical du ou de la salarié·e. Il/elle ne doit traiter que les besoins d’aménagement. Solidaires doit dénoncer toute dérive où le ou la référent·e “jouerait au docteur”.

- L’autonomie des salarié·es : Le ou la référent·e ne doit pas décider du projet professionnel du ou de la salarié à sa place.

4. Action Syndicale : Comment interagir ?

- L’interpeller en instance : En CSE ou FSSSCT, demandez un bilan régulier de son activité : “Combien de salarié·es a-t-iel accompagné·es cette année ? Quel est le montant des aides obtenues ?”

- Accompagner le ou la camarade : Un·e salarié·e peut demander à être accompagné·e par un·e délégué·e Solidaires lors d’un entretien avec le ou la référent·e handicap de l’employeur. Et c’est conseillé pour éviter toute pression.

- Utiliser ses moyens, pas ses consignes : Considérez le ou la référent·e employeur comme un “guichet de ressources”. Nous allons le ou la voir pour obtenir le financement d’un siège ergonomique ou d’un logiciel, mais nous gardons la main sur la stratégie de défense et la contestation si l’aménagement proposé est insuffisant.

FICHE 13 : Élections Professionnelles et Représentativité

L’objectif : Garantir que les personnes en situation de handicap soient actrices de la négociation collective et non simples spectatrices des décisions prises à leur sujet.

1. Listes candidates :

- Valoriser le vécu : Un·e camarade en situation de handicap possède une expertise irremplaçable sur l’accessibilité, l’ergonomie et l’organisation du travail. C’est une force pour toute la liste Solidaires.

- Représentativité réelle : Une liste qui ressemble au corps électoral est une liste plus forte. Si 6% (ou plus) des salarié·es sont en situation de handicap, il est politique que nos listes reflètent cette réalité.

- Rappel légal : L’employeur ne peut en aucun cas s’opposer à une candidature au motif du handicap. Ce serait une discrimination électorale lourdement sanctionnée.

2. Accessibilité du mandat :

Une fois élu·e, le ou la camarade doit pouvoir exercer son mandat dans les mêmes conditions que les autres. Le syndicat doit exiger :

- Aménagement des heures de délégation : Pour les camarades ayant une grande fatigabilité, négocier une flexibilité dans la prise des heures (par demi-heures, par exemple).

- Déplacements : Si le handicap empêche l’usage des transports en commun ou la conduite, le syndicat doit exiger que l’employeur prenne en charge les frais de taxi ou de transport adapté pour se rendre aux réunions du CSE/FSSSCT.

- Matériel de l’élu·e : L’ordinateur, le téléphone ou les logiciels fournis par l’entreprise pour le mandat doivent être adaptés (ex: synthèse vocale, clavier spécifique).

- Accessibilité des réunions : Les réunions de l’instance doivent se tenir dans des salles accessibles, avec interprétation LSF ou vélotypie si nécessaire (frais à la charge de l’employeur au titre du fonctionnement de l’instance).

3. Profession de foi :

- Le format FALC : En plus de la version classique, produisez une version en Facile à Lire et à Comprendre.

- Le vote numérique : Si le vote se fait en ligne (voir nos conseils précédents), détaillez la procédure étape par étape avec des captures d’écran simples.

- Accessibilité numérique : Si vous envoyez votre profession de foi par mail, vérifiez que le PDF est “lisible” par les logiciels de lecture d’écran (ne pas envoyer juste une photo du tract).

4. La discrimination syndicale “double”

- Vigilance : Soyez attentifs·ves aux pressions que pourraient subir les candidat·es en situation de handicap (“Tu es déjà fragile, le mandat va t’achever”, etc.). Ce sont des propos validistes visant à écarter les personnes de la vie démocratique. Solidaires défend le droit de chacun·e à l’engagement militant.

FICHE 14 : Défense Juridique et Discriminations

L’objectif : Garantir que le handicap ne soit pas un frein à la carrière, ni un motif de sortie de l’entreprise ou de l’administration.

1. Le Secret Médical :

- Le diagnostic ne regarde que le ou la salarié·e : L’employeur, les RH,

ou le ou la responsable n’ont aucun droit de connaître la pathologie (le nom de la maladie ou la nature du handicap). - Ce qu’on communique : On ne parle que des incidences sur le travail (ex: “ne peut pas porter de charges”, “doit travailler dans le calme”, “besoin de pauses visuelles”).

- Vigilance en temps que syndicaliste : Si un employeur insiste pour savoir “ce que vous avez”, c’est une pression illégale. Le ou la salarié·e peut répondre : “Ma santé relève du secret médical, discutons plutôt des aménagements préconisés par le/la médecin du travail.”

2. La lutte contre l’inaptitude “de confort”

L’inaptitude est trop souvent utilisée par les patrons pour se débarrasser d’un·e salarié·e devenu·e “gênant·e”.

- L’obligation de reclassement (Art. L1226-2 du Code du Travail) : Avant de licencier pour inaptitude, l’employeur doit chercher réellement et sérieusement à reclasser le ou la salarié·e sur un autre poste, même par voie de mutation ou de transformation de poste.

- La loyauté de la recherche : Le syndicat doit exiger la liste des postes vacants. Si l’employeur dit “il n’y a rien”, mais qu’il embauche en intérim ou en CDD sur des postes compatibles, le licenciement peut être contesté et annulé.

- Le rôle de la Médecine du Travail : C’est le seul interlocuteur médical. Solidaires doit encourager les collègues à solliciter des visites de pré-reprise pendant leur arrêt pour préparer les aménagements avant que l’inaptitude ne soit prononcée.

3. Évolution de carrière et “Plancher de verre”

Le handicap ne doit pas entraîner une stagnation professionnelle.

- Égalité de traitement : Le Code du Travail interdit de prendre en compte le handicap pour les promotions, les augmentations ou la formation.

- L’absence pour soins n’est pas un manque d’engagement : Si un·e collègue est absent·e pour des soins ou des cures liés à son handicap, cela ne doit pas justifier une baisse de prime ou un refus de promotion. C’est une discrimination indirecte.

- Action Solidaires : Lors des Négociations Annuelles Obligatoires (NAO), demandez les statistiques comparatives : quel est le salaire moyen et le taux de promotion des travailleurs et travailleuses handicapé·es par rapport au reste de l’entreprise ?

4. Recours en cas de discrimination

Si le dialogue échoue, Solidaires accompagne le ou la camarade vers :

- Le Défenseur des Droits (ou ses délégué·es dans les départements): Pour obtenir une enquête et des recommandations officielles.

- Le Conseil de Prud’hommes ou le Tribunal Administratif : Pour demander l’annulation d’une sanction ou l’obtention de dommages et intérêts.

- Le Code Pénal (Art. 225-1) : Rappeler à l’employeur que la discrimination liée à l’état de santé est un délit passible de prison.

“Tout écrit est une preuve.” Conseillez aux camarades de toujours confirmer par écrit (mail ou courrier) les demandes d’aménagement et les réponses (ou absences de réponse) de l’employeur. En cas de litige juridique, c’est ce “traçage” qui permettra de prouver que l’employeur n’a pas rempli ses obligations.

FICHE 15 : Télétravail et Inclusion

L’objectif : Utiliser le télétravail comme un levier, pas comme une mise à l’écart.

1. Le Télétravail : Un aménagement, pas une faveur

- Droit à l’aménagement : Selon le Code du Travail (Art. L1222-9), l’employeur doit prioritairement accorder le télétravail aux travailleurs et travailleuses handicapé·es si leur état de santé le demande.

- Le refus doit être motivé : Si l’employeur refuse le télétravail à un·e salarié·e handicapé·e alors que le poste le permet, il doit justifier son refus de manière très précise. Un refus injustifié peut être considéré comme une discrimination.

2. L’Équipement au domicile : La charge de l’employeur

- Principe d’égalité : Le poste de travail à domicile doit être aussi ergonomique que celui du bureau.

- Financement : C’est à l’employeur de payer et d’installer le matériel spécifique (siège ergonomique, bureau réglable, logiciels de synthèse vocale, double écran) au domicile du ou de la salarié·e. Il peut pour cela solliciter les aides de l’Agefiph ou du FIPHFP.

- Solidaires revendique : La priorité reste l’adaptation du poste sur le site de travail. Le télétravail ne doit jamais être une solution d’économie pour l’employeur qui refuserait de rendre ses locaux accessibles.

3. La Position Politique de Solidaires : Lutter contre l’isolement

- Contre le 100% imposé : Solidaires s’oppose au télétravail total imposé par l’employeur. Cela génère une perte de rythme, une coupure avec le collectif de travail et une invisibilisation des collègues handicapé·es.

- Lutter contre la ségrégation : Inclure, c’est permettre d’être ensemble. Le télétravail ne doit pas servir à “cacher” le handicap hors des murs de l’entreprise ou de l’administration.

- Le volontariat et le sur-mesure : La fréquence du télétravail doit être décidée avec le ou la travailleur·euse, selon sa situation personnelle (fatigabilité liée aux transports, nature du handicap, environnement géographique).

4. Le lien social et le “Droit au retour”

- Maintien du collectif : Le syndicat doit veiller à ce que les collègues en télétravail reçoivent les mêmes informations, participent aux réunions (en visio accessible) et conservent leurs droits syndicaux.

- Réversibilité : Un·e camarade doit pouvoir mettre fin au télétravail ou modifier sa fréquence dès qu’il ou elle le souhaite si les conditions de travail sur site sont (enfin) rendues accessibles.

Pour l’Union syndicale Solidaires le télétravail est un outil, pas une prison. Nous refusons que le télétravail soit la réponse systématique à un défaut d’accessibilité des locaux. L’employeur a l’obligation de rendre le site de travail inclusif. Le télétravail doit rester un choix pour le confort et la santé du ou de la salarié·e, jamais une obligation pour masquer l’inaction de la direction.

Texte du congrès de Labège 2024

Le Télétravail et handicap

Solidaires est contre le télétravail à 100 %, qui génère perte du collectif de travail, perte du rythme de travail et mise à l’écart, à l’opposé d’une société inclusive, lorsque l’état de santé des personnes concernées ne l’exige pas. Sur un plan général, il faut éviter de recréer de la ségrégation au travail vis-à-vis des travailleuses/travailleurs en situation de handicap.

Solidaires revendique

- La priorité à l’adaptation du poste, même en télétravail. Ainsi que celle du site pour les besoins de la travailleuse/travailleur handicapé·e.

- Le télétravail reste à titre subsidiaire et non imposé, dans le respect des textes en vigueur avec toutes les adaptations nécessaires du poste de télétravail en fonction des besoins de la personne handicapée, pris en charge par l’employeur. Par conséquent, si le recours au télétravail peut s’avérer utile, il est à examiner au cas par cas, au regard de la situation personnelle du travailleur ou de la travailleuse en situation de handicap (situation géographique, nature du handicap, fatigabilité). La mise en œuvre du télétravail et sa fréquence doivent être décidées avec le ou la travailleuse/travailleur handicapée, en fonction de ses besoins.

- Le télétravail et sa fréquence ne doivent pas être imposés unilatéralement par l’entreprise afin de ne pas causer l’exclusion systématique des personnes handicapées des lieux de travail collectifs.

Agir dans les Instances

FICHE 16 : Les principales institutions

- Le CNCPH (National) : Conseil National Consultatif des Personnes Handicapées. Le rôle du CNCPH est de garantir la participation directe des personnes handicapées et de leurs représentant·es à la construction des politiques publiques. Il agit comme un garde-fou en rendant des avis sur les lois avant leur adoption et en proposant des améliorations concrètes sur tous les sujets de la vie quotidienne (emploi, accessibilité, santé). Il comporte un collège “Organisations Syndicales” qui a pour fonction de défendre les intérêts des travailleurs handicapés lors de l’élaboration des textes, en veillant particulièrement à leur maintien dans l’emploi et à leurs conditions de travail.

- L’AGEFIPH & le FIPHFP (National & Régional) : Ce sont les fonds qui gèrent l’argent des contributions patronales (payées par les entreprises qui n’atteignent pas les 6% de travailleurs handicapés). Ils financent les aménagements de poste, les prothèses, les formations et les aides au maintien dans l’emploi. Ce sont des organismes paritaires (gérés par syndicats et employeurs). Les syndicats y siègent pour décider du budget et des priorités. Ils veillent à ce que l’argent soit bien utilisé pour aider les salarié·es (aides directes, formation) et pas seulement pour de la communication d’entreprise par exemple.

- Le CDCA (Départemental) : Conseil Départemental de la Citoyenneté et de l’Autonomie. C’est une instance consultative qui conseille le Département sur les politiques de transports, de logement, de culture et d’aides à l’autonomie. Les représentant·es syndicales et syndicaux y font le lien entre la vie sociale et la vie professionnelle. Ils et elles s’assurent, par exemple, que les transports adaptés fonctionnent aux horaires de travail des salarié·es, et pas seulement pour les loisirs.

- La MDPH & sa CDAPH (Départemental) : La Maison Départementale des Personnes Handicapées. C’est le guichet unique où l’on dépose les dossiers. Au sein de la MDPH, la CDAPH (Commission des Droits et de l’Autonomie) est l’instance qui prend les décisions finales sur l’attribution des droits (AAH, RQTH, orientation professionnelle). Des représentant·es syndicales et syndicaux siègent à la CDAPH avec droit de vote. Ils elles examinent les dossiers individuels pour empêcher les refus administratifs injustifiés. Ils et elles défendent le projet de vie du ou de la salarié·e (par exemple : éviter qu’un·e salarié·e soit orienté vers un ESAT s’il ou elle peut travailler en milieu ordinaire avec un aménagement).

FICHE 17 : Modèle de lettre pour l’Union Départementale (UD)

Objet : Candidature de l’Union Syndicale Solidaires [Nom du département] pour siéger au sein du [CDCA ou CDAPH]

À l’attention de [Monsieur/Madame le/la Président·e du Conseil Départemental] ou [Monsieur/Madame le/la Préfet·e]

Monsieur/Madame,

L’Union syndicale Solidaires [Nom du département] est un acteur majeur de la défense des travailleurs et travailleuses sur notre territoire. À ce titre, nous portons une attention particulière aux politiques publiques de l’autonomie et du handicap, qui touchent les salarié·es que nous représentons.

Conformément aux dispositions du Code de l’action sociale et des familles, nous souhaitons par la présente manifester notre volonté de siéger au sein du [Conseil Départemental de la Citoyenneté et de l’Autonomie (CDCA) / de la Commission des Droits et de l’Autonomie des Personnes Handicapées (CDAPH)].

Notre organisation syndicale dispose d’une représentativité établie [préciser ici : ex : “dans la fonction publique territoriale”, ou “au travers de nos résultats aux élections professionnelles locales”]. Nos militant·es sont formé·es aux problématiques de maintien dans l’emploi, d’aménagement raisonnable et d’accès aux droits. Leur présence au sein de votre instance permettrait d’apporter une expertise syndicale de terrain, indispensable pour garantir l’effectivité des droits des citoyens et citoyennes et des travailleurs et travailleuses en situation de handicap dans notre département.

Nous vous remercions de nous indiquer les modalités pratiques de désignation de nos représentant·es pour le prochain renouvellement de l’instance ou en cas de siège vacant.

Dans l’attente de votre réponse, nous vous prions d’agréer, Monsieur/Madame, l’expression de nos salutations syndicales.

Pour l’Union Syndicale Solidaires [Département], [Nom du/de la secrétaire de l’UD]

FICHE 18 : Agir en FSSSCT (Secteur Public / Hôpital)

L’enjeu : Utiliser l’argent du FIPHFP pour améliorer la santé des agent·es.

1. Exiger la transparence sur les fonds FIPHFP

- La base légale : L’article L131-8 du CGFP (Code Général de la Fonction Publique) rappelle l’obligation de l’employeur public de favoriser l’insertion professionnelle des personnes handicapées.

- L’action syndicale : La plupart des hôpitaux et grandes collectivités signent une Convention avec le FIPHFP. En Formation Spécialisée (FSSSCT), nous devons exiger chaque année le bilan financier de cette convention.

- Les questions à poser : “Quel est le montant des aides perçues ?”, “Pourquoi une partie des crédits n’a-t-elle pas été consommée alors que des agent·es attendent du matériel ?”. L’argent du FIPHFP est une “recette” dédiée : l’administration ne peut pas invoquer un manque de budget propre pour refuser un aménagement.

2. Reclassement : Un droit à une carrière digne

- La base légale : Les articles L826-1 à L826-3 du CGFP encadrent la période de préparation au reclassement (PPR). Le reclassement n’est pas une “faveur”, c’est une obligation dès lors que l’agent·e est déclaré· inapte à ses fonctions.

- Vigilance Solidaires : Nous refusons le reclassement “sanction” (perte de prime, poste isolé). La FSSSCT doit veiller à ce que le poste de reclassement soit assorti d’une formation de reconversion (financée par le FIPHFP) et qu’il soit réellement adapté aux restrictions médicales.

3. Le DUERP : Intégrer le handicap dans la prévention

- La base légale : L’article L4121-1 du Code du Travail (applicable à la fonction publique) oblige l’employeur à évaluer tous les risques.

- L’action syndicale : Le Document Unique d’Évaluation des Risques Professionnels (DUERP) doit prendre en compte les situations de handicap.

- Exemple : L’évacuation d’urgence pour les PMR, la fatigabilité liée au travail posté pour les maladies chroniques, ou les risques liés au bruit pour les collègues malentendant·es.

4. Revendication Solidaires : Le droit au matériel sans délai

- Le constat : Trop souvent, entre la préconisation du médecin du travail et l’achat du fauteuil ou du logiciel, il se passe 6 mois ou un an. Pendant ce temps, la santé de l’agent·e se dégrade.

- Notre exigence : “Tout matériel ergonomique ou aménagement technique préconisé par la médecine du travail doit être livré et installé dans un délai maximal de 2 mois.” L’employeur doit utiliser les procédures d’achat d’urgence ou les fonds de roulement de la convention FIPHFP.

“Le médecin propose, l’employeur dispose (et finance).”

Si l’administration refuse un aménagement en disant que c’est “impossible”, elle doit le justifier par écrit. En instance, rappelez l’article L5213-6 : l’employeur doit prouver que les mesures imposeraient une charge disproportionnée, ce qui est impossible à justifier si les fonds du FIPHFP n’ont pas été totalement sollicités.

FICHE 19 (Développée) : Agir en CSE / CSSCT (Secteur Privé)

L’objectif : Utiliser les prérogatives du Comité Social et Économique pour transformer l’obligation d’emploi en droits concrets et vérifier l’utilisation des fonds Agefiph.

1. La consultation sur la Politique Sociale

- La base légale : L’article L2312-26 du Code du travail oblige l’employeur à consulter chaque année le CSE sur la politique sociale. Ce volet inclut obligatoirement les actions de “maintien dans l’emploi des travailleurs handicapés”.

- L’action syndicale : Lors de cette consultation, Solidaires doit exiger le bilan de la DOETH (Déclaration Obligatoire d’Emploi des Travailleurs Handicapés).

- Les questions clés : “Combien de salarié·es handicapé·es ont été recruté·es en CDI cette année ?”, “Quel est le montant de la contribution versée à l’Agefiph ?”. En tant que syndicaliste on doit opposer à l’employeur : “Plutôt que de payer des pénalités à l’Agefiph, utilisez cet argent pour aménager les postes de nos collègues !”

2. La CSSCT : Le bras armé de la santé au travail

- La base légale : L’article L2312-9 précise que le CSE procède à l’analyse des risques professionnels auxquels peuvent être exposés les travailleurs et travailleuses, notamment les femmes enceintes et les personnes handicapées.

- Le droit d’alerte : Si l’employeur refuse un aménagement raisonnable (voir Fiche 11), les élu·es peuvent déclencher un Droit d’alerte pour atteinte aux droits des personnes (Art. L2312-59), car le refus d’aménagement est une discrimination.

3. L’expertise pour “Risque Grave”

- La base légale : L’article L2315-94 permet au CSE de faire appel à un·e expert·e habilité·e en cas de risque grave constaté dans l’entreprise.

- L’action syndicale : Si plusieurs collègues en situation de handicap (ou de retour de longue maladie) subissent des dégradations de santé faute d’aménagements, le CSE peut voter une expertise. C’est un levier très puissant pour forcer l’employeur à revoir toute son organisation (ergonomie, rythmes de travail, accessibilité des locaux).

4. Revendication Solidaires : L’accès à l’information

- L’accès au BDESE : La Base de Données Économiques, Sociales et Environnementales doit contenir les informations sur l’emploi des personnes handicapées. Solidaires revendique un accès total et clair à ces données pour vérifier que les collègues handicapé·es ne subissent pas de “déclassement” salarial.

- Moyens Agefiph : L’employeur doit informer le CSE de toutes les aides financières sollicitées et obtenues auprès de l’Agefiph pour éviter que les fonds de l’entreprise ne soient indûment ponctionnés alors que des aides externes existent.

“Pas de compromis sur la discrimination.”

L’employeur doit “prendre les mesures appropriées” (Art. L5213-6). Si le CSE propose une solution technique viable et financée par l’Agefiph, l’employeur ne peut pas la refuser sans commettre une discrimination. Notez systématiquement ces échanges au procès-verbal (PV) de la réunion pour préparer un éventuel recours juridique.

Outils et culture militante

FICHE 20 : Lexique et Culture de l’Allié·e

L’objectif : Faire évoluer nos mentalités et nos langages pour qu’ils ne soient plus des barrières. L’accessibilité commence par les mots que l’on utilise.

1. Le Lexique Technique (Pour comprendre et agir)

- L’accessibilité universelle : Ce n’est pas faire “un petit plus” pour les personnes en situation de handicap, c’est concevoir des lieux et des outils utilisables par tout le monde dès le départ.

- La Vélotypie : C’est la transcription de la parole en texte en temps réel (souvent projeté sur écran en réunion). C’est indispensable pour les camarades sourd·es ou malentendant·es qui ne pratiquent pas la LSF.

- La LSF (Langue des Signes Française) : Une langue à part entière avec sa propre grammaire. Attention : un·e interprète LSF est un·e professionnel·le, ce n’est pas quelqu’un·e qui a appris quelques signes ou qui se débrouille en LSF.

- La boucle magnétique : Un système qui permet aux personnes appareillées de recevoir le son du micro directement dans leur appareil, sans les bruits ambiants.

2. Déconstruire le Validisme et la Psychophobie

- Le Validisme : C’est le système d’oppression qui considère que les personnes valides sont la “norme”. Il se traduit par l’idée qu’une personne handicapée est “moins capable” ou qu’elle doit “faire des efforts” pour s’adapter à la société.

- La Psychophobie : Ce sont les préjugés et les discriminations envers les personnes ayant des troubles psychiques (dépression, bipolarité, schizophrénie, etc.).

Nous refusons d’utiliser le handicap comme une insulte (ex: éviter « c’est schizophrène », « c’est un dialogue de sourds », « il est autiste ce patron » « faut être aveugle / fou pour ne pas voir ça » ). Ces expressions renforcent les stigmates.

3. La posture de l’Allié·e

- Demander avant d’aider : Ne poussez jamais un fauteuil roulant sans demander. Ne prenez pas le bras d’une personne aveugle sans prévenir. Ne donnez pas à manger à un animal d’accompagnement.

- S’adresser à la personne : Si un·e camarade est accompagné·e d’un interprète ou d’un·e auxiliaire, regardez et parlez à la personne handicapée, pas à son accompagnateur ou accompagnatrice.

- Reconnaître ses erreurs : On peut tous et toutes se tromper. L’important est d’écouter la critique des personnes concernées et de corriger sa pratique pour la prochaine fois.

La check-list finale

Le mémo de l’accessibilité pour chaque action militante.

COMMUNICATION

RÉUNIONS & FORMATIONS

MANIFESTATIONS

DÉFENSE DES CAMARADES

POSTURE

- RESSOURCES : Liens utiles pour l’accessibilité

1. Pour la défense juridique et les droits

- Le Défenseur des Droits : Organisme indépendant qui lutte contre les discriminations.

- Utilité : Saisir le ou la délégué·e local·e pour un refus d’aménagement raisonnable ou une discrimination liée au handicap.

- Site : defenseurdesdroits.fr (rubrique “Saisir le délégué de votre département”).

- Commission contre les discriminations liées au handicap de Solidaires : contact@solidaires.org

Et les vidéos de Solidaires sur le sujet à voir et à diffuser lors de formations, accueils, AG, etc :

2. Pour l’accessibilité numérique et documentaire

- Access42 : Des fiches pratiques pour rendre vos PDF et sites web accessibles.

- Le FALC (UNAPEI) : Le guide officiel et les règles pour rédiger en “Facile à Lire et à Comprendre”.

- Adobe Color : Pour vérifier que le contraste entre votre texte et votre fond est suffisant (accessibilité visuelle).

- CapCut ou Subly : Outils simples pour ajouter des sous-titres automatiques à vos vidéos militantes.

3. Pour l’accessibilité des lieux et le matériel

- Jaccede : Le guide collaboratif pour trouver des lieux de réunion ou de convivialité réellement accessibles.

- Acceslibre : Plateforme publique (beta.gouv.fr) pour vérifier l’accessibilité des établissements recevant du public (ERP).

- Arasaac & Sclera : Bibliothèques gratuites de pictogrammes pour vos documents FALC ou vos plannings visuels.

4. Pour la communication (LSF et Interprétariat)

- AFILS : Annuaire pour trouver des interprètes en Langue des Signes Française (LSF) diplômé·es.

- Prestataires de Vélotypie (Sous-titrage en direct) : Pour vos congrès ou AG, contactez des professionnel·les comme VoxA, Le Messageur ou Système 16. Note : Anticipez vos demandes au moins 1 mois à l’avance, les vélotypistes sont peu nombreux·ses et très sollicité·es !

- L’alternative “Low Cost” (Automatique) : Si une petite section Solidaires n’a pas les moyens de payer un·e vélotypiste professionnel·le (qui coûte assez cher car c’est une haute technicité) : Ava (app.ava.me) : Une application qui permet de sous-titrer les réunions en direct sur smartphone ou ordinateur. C’est moins précis qu’un·e humain·e, mais c’est un bon début pour l’accessibilité “au quotidien”.

5. Culture et Lutte (Pour déconstruire le validisme)

- Les Dévalideuses : Collectif handi-féministe.

- À voir : Leurs affiches antivalidistes et leurs “bonnes résolutions” pour changer de regard sur le handicap. lesdevalideuses.org

- Le CLHEE : Collectif de Lutte pour l’Émancipation des Personnes Handicapées. Pour une approche politique et radicale de l’autonomie. clhee.org

- CLE Autiste (Collectif pour la Liberté d’Expression des Autistes) : Pour tout ce qui concerne la neurodiversité. Ils et elles luttent pour que l’autisme ne soit plus vu comme une “maladie à soigner” mais comme une différence à respecter. Très utile pour tes fiches sur les formations et les réunions (gestion du bruit, consignes claires). Lien : cle-autistes.fr

- Handisocial : Association de défense des droits des personnes handicapées. Leur site est une mine d’or pour décrypter les textes de loi complexes (AAH, réformes, droits sociaux) avec un regard critique et militant. Ils et elles proposent souvent des analyses très pointues sur les reculs de droits. Site : handisocial.fr

- Femmes pour le Dire, Femmes pour Agir (FDFA) : propose une permanence d’écoute téléphonique spécialisée pour les femmes handicapées victimes de violences ou de discriminations. Elles luttent contre la “double discrimination” (sexisme + validisme). Contact : fdfa.fr ou leur numéro d’écoute : 01 40 47 06 06 (Écoute Violences Femmes Handicapées).

Glossaire

AAH : Allocation Adulte Handicapé

AT/MP : Accident du Travail / Maladie Professionnelle

AESH : Accompagnant-e des Elèves en Situation de Handicap. L’attribution d’un AESH est notifiée par la CDATH.

AJPA : Allocation Journalière de Proche Aidant

AJPP : Allocation Journalière de Présence Parentale

AGEFIPH : Association de Gestion du Fonds pour l’Insertion des Personne Handicapées

APA : Allocation Personnalisée d’Autonomie

BOETH : Bénéficiaire de l’obligation d’emploi de travailleurs handicapés

CASA : Contribution Additionnelle de Solidarité pour l’Autonomie

CAT : Centres d’aide par le travail, devenus les ESAT (voir ce mot) avec la loi de 2005

CDAPH : Commission des Droits de l’Autonomie des Personnes Handicapées, elle est rattachée à la MDPH.

CMI : Carte Mobilité Inclusion

CNAF : Caisse Nationale des Allocations Familiales

CNAM : Caisse Nationale de l’Assurance Maladie

CNAV : Caisse Nationale d’Assurance Vieillesse

CNSA : Caisse Nationale de Solidarité pour l’Autonomie

CSA : Contribution de Solidarité pour l’Autonomie

CSE : Comité Social et Economique

CSG : Contribution Sociale Généralisée

DOETH : déclaration d’emploi de travailleurs/euses en situation de handicap

DREETS : Directions Régionales de l’Economie, de l’Emploi, du Travail et des Solidarités

E.A.Entreprise Adaptée : l’E.A est une entreprise adaptée du milieu ordinaire soumise au Code du Travail, qui a la spécificité d’employer au moins 55% de travailleurs/euses handicapé-es parmi ses effectifs de production. Ces travailleurs/euses sont recruté-es parmi les personnes sans emploi plus éloignées du marché du travail.

EATT : entreprise adaptée de travail temporaire, spécialiste du travail temporaire tournée vers les intérimaires en situation de handicap. Elle peut proposer des contrats de mission ou des CDI intérimaires.

EMPOWERMENT: Ne me libère pas, je m’en charge. Les bases de l’empowerment sont là : par le fait du nombre et de l’appartenance à une communauté ayant un destin (insatisfaisant) en partage, les exclu- es cassent l’isolement dans lequel on les a tenu-es ; et par leur action collective, menée par des leaders qu’ils et elles se sont choisi-es. Ils et elles sont bien décidé-es à prendre le pouvoir sur leur vie, sans attendre que les pouvoirs en place le leur accordent, selon leur agenda et leur méthodologie.

ESAT : Etablissement et Services d’Accompagnement par le Travail ESH : Etudiant-e en situation de handicap

ETP : Equivalent Temps plein

FIPHFP : Fonds pour l’Insertion des Personnes Handicapées dans la Fonction Publique FALC : Facile à lire et à comprendre.

IME : Instituts Médico-Educatifs. Accueillent des jeunes présentant des troubles importants des fonctions cognitives.

IMPRO : Institut médico-professionnel. Organismes de soutien et de services aux personnes handicapées.

ITEP : instituts thérapeutiques, éducatifs et pédagogiques. Etablissements accueillant des enfants et adolescent-es dont les troubles du comportement perturbent gravement la socialisation et l’accès aux apprentissages. L’accueil en ITEP est prononcé suite à l’orientation de la CDATH.

LSF : langue des signes

MDPH : Maison Départementale des Personnes Handicapées

NAO : Négociation Annuelle Obligatoire

OETH : Obligation d’Emploi des Travailleurs Handicapés

PCH : Prestation de Compensation du Handicap

PIAL : pôles inclusifs d’accompagnement localisés. Ils organisent la gestion départementale des AESH.

RQTH : Reconnaissance de la Qualité de Travailleur Handicapé.

SEGPA : la classe SEGPA (collège) est une section d’enseignement général et professionnel adapté aux jeunes de la 6ème à la 3ème présentant des difficultés scolaires importantes.

SSEFS : service de soutien à l’Education familiale et à la scolarisation pour les jeunes handicapé-es auditifs de 3 à 20 ans.

SESSAD : Services d’Education Spécialisés et de soins à domicile. Ces services médico-sociaux interviennent auprès de jeunes handicapé-es moteurs ou pour les jeunes présentant une déficience intellectuelle de la naissance à 20 ans. Leur action vise à apporter un soutien spécialisé aux enfants et adolescent·es handicapé·es dans leur milieu de vie et d’éducation ainsi qu’à leur famille.

TDAH : Troubles du déficit de l’attention avec ou sans hyperactivité.

ULIS : Unités localisées pour l’inclusion scolaire. Les ULIS sont des classes particulières pour la scolarisation d’élèves en situation de handicap avec des temps d’inclusion dans des classes dites ordinaires

Le handicap n’est pas une question de santé individuelle, c’est une question de justice sociale. Pour l’Union syndicale Solidaires, l’accessibilité est un combat de classe.

Ce guide pratique a été conçu pour donner à chaque militant·e, élu·e ou référent·e les outils pour agir :

- 20 fiches pratiques pour transformer nos réunions, nos manifs et nos lieux de travail.

- Le cadre juridique complet pour imposer les aménagements raisonnables et lutter contre les discriminations.

- Des modèles d’action concrets pour conquérir nos droits dans les instances (CSE, FSSSCT, MDPH).

Parce que notre syndicalisme ne sera jamais vraiment unitaire s’il n’est pas accessible à toutes et tous. Rien sur nous sans nous !